Meta heeft woensdag vier in-house chips onthuld, speciaal ontworpen voor AI-toepassingen, als onderdeel van de grootschalige uitbreiding van zijn datacenters. De chips maken deel uit van de Meta Training and Inference Accelerator (MTIA)-familie en geven het bedrijf meer flexibiliteit en bescherming tegen prijsveranderingen bij silicon-leveranciers. Het eerste model, MTIA 300, werd enkele weken geleden al ingezet voor kleinere AI-taken zoals contentranking en advertentie-aanbevelingen.

Meta wil elke zes maanden een nieuwe chip uitbrengen.

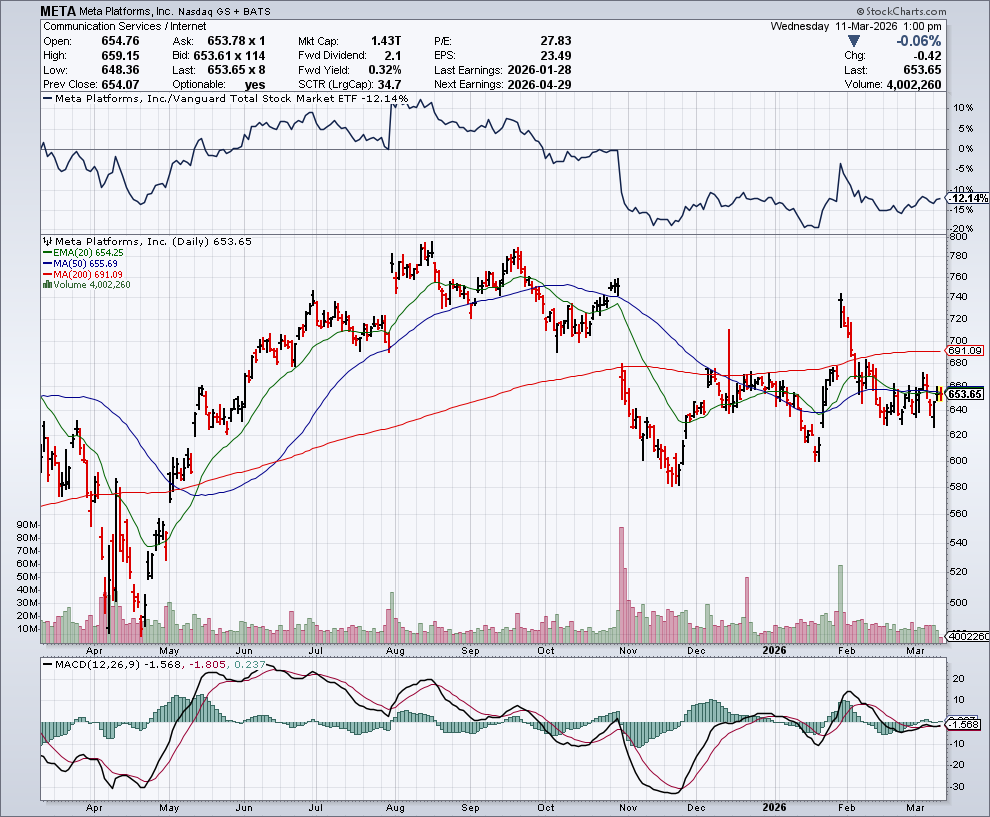

In de onderstaande grafiek zien we het koersverloop van Meta:

Snelle chipontwikkeling voor AI-infrastructuur

De komende MTIA 400, 450 en 500 richten zich op generatieve AI-taken zoals het maken van afbeeldingen en video’s, maar niet op het trainen van grote taalmodellen.

Song benadrukte dat de chips een geschatte levensduur van vijf jaar hebben en meer high-bandwidth memory (HBM) bevatten voor AI-inference.

Meta maakt de chips in samenwerking met Taiwan Semiconductor Manufacturing Company en heeft daarnaast recent miljarden geïnvesteerd in Nvidia- en AMD-GPU’s om de datacenters te vullen.

Het bedrijf bouwt momenteel datacenters in Louisiana, Ohio en Indiana en bekijkt extra ruimte in Texas. De combinatie van eigen silicon en grote GPU-deals moet Meta flexibiliteit bieden bij de snel veranderende AI-workloads.

Interne focus en supply chain

In tegenstelling tot Google en Amazon, gebruikt Meta zijn MTIA-chips uitsluitend intern. Song zegt dat het bedrijf zich zorgen maakt over HBM-tekorten, maar dat het de levering voor de geplande uitbreidingen veiligstelt.

De meeste ingenieurs die aan de chips werkten, zijn in de VS gevestigd, waar ook 26 van de 30 operationele en geplande datacenters zich bevinden.

Bron: CNBC

Foto: iStock